.png)

Las alucinaciones de la IA no son un bug menor. En entornos empresariales, una respuesta fabricada puede traducirse en una decisión equivocada, un contrato mal ejecutado o una auditoría fallida. Esto es lo que está en juego y cómo se resuelve.

Cuando ChatGPT inventa el nombre de un restaurante que no existe, el daño es mínimo. Cuando tu sistema de IA empresarial inventa un número de contrato, un monto aprobado o una cláusula legal, el daño puede ser irreversible.

Eso es una alucinación. Y ocurre más seguido de lo que los equipos de tecnología admiten.

Los modelos de lenguaje grande (LLMs) funcionan por probabilidad. Predicen qué texto debería seguir a otro según patrones aprendidos en millones de documentos. Cuando el contexto es ambiguo o la información no está en sus datos de entrenamiento, el modelo no dice "no sé". Completa el espacio con lo que estadísticamente parece correcto.

En una conversación casual, eso es tolerable. En un flujo de trabajo empresarial donde esa respuesta alimenta una decisión financiera, legal o operativa, es inaceptable.

En B2B, la IA no responde preguntas de trivia. Procesa contratos, genera reportes, clasifica transacciones, redacta propuestas, extrae términos de acuerdos y alimenta sistemas que otros sistemas usan para operar.

Cada uno de esos casos tiene algo en común: la salida de la IA se convierte en un insumo para una decisión real. Y cuando esa salida está fabricada, la cadena de errores puede ser larga antes de que alguien lo detecte.

No siempre es obvia. A veces es un número levemente distinto. Un nombre de cláusula que casi existe. Un dato que parece correcto pero viene de un contexto equivocado. Estos son los tipos de alucinación más comunes en entornos B2B:

Cualquier industria que use IA para procesar información que luego alimenta decisiones operativas, financieras o legales está expuesta. Estos son los sectores donde el costo de una alucinación es más alto:

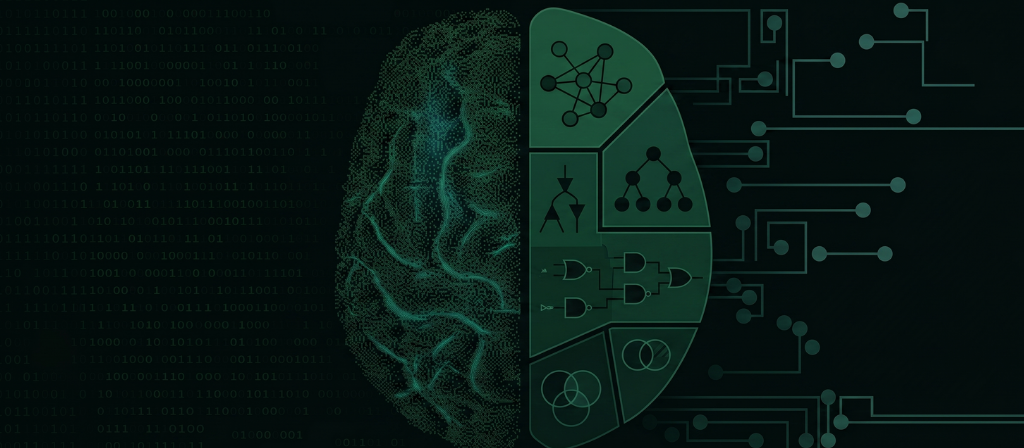

La razón por la que las alucinaciones son difíciles de eliminar en los LLMs convencionales no es técnica. Es estructural.

Un modelo de lenguaje no tiene acceso a la verdad. Tiene acceso a patrones. Cuando se le pide que procese un contrato específico de tu empresa, no puede verificar si los datos que extrae corresponden a lo que realmente está en el documento fuente o en tu base de datos. Solo puede hacer su mejor predicción.

Por eso agregar más datos de entrenamiento o usar modelos más grandes no resuelve el problema de fondo. La alucinación no es un problema de tamaño del modelo. Es un problema de arquitectura.

La IA neuro-simbólica no reemplaza los modelos de lenguaje. Los complementa con una capa de razonamiento que los LLMs puros no tienen: reglas explícitas y verificables contra las cuales cada salida se valida antes de ser usada.

La arquitectura funciona en dos capas que operan en secuencia:

El resultado es un sistema que combina la comprensión flexible de los LLMs con la precisión verificable del razonamiento basado en reglas. Uno entiende. El otro confirma.

Antes de implementar cualquier solución de IA en un flujo de trabajo empresarial, estas son las preguntas que deben tener respuesta:

Si alguna de estas preguntas no tiene una respuesta clara, el sistema está asumiendo un nivel de riesgo que probablemente no está documentado en ningún análisis de riesgo operativo.

.png)

.png)

Despachos contables y la razón de como pierden productividad.

.png)

ERP Pasivo se puede integrar a su e-commerce y escalar tu operación eliminando las tareas repetitivas.

.png)

La IA neuro simbolica va ganando terreno en los despachos contables, descubre como:

Descubre como recuperar el tiempo y el control en tu constructora.

Conoce la novedad del ERP Pasivo que esta ayudando a eliminar las tares manuales/repetitivas

Descubre como la IA Neuro Simbolica esta ganando protagonismo en el mundo corporativo y como puedes implementarla en tu empresa.

Aprende a gestionar datos financieros con precisión mediante procesos digitales que eliminan el error humano en tu ERP.

.png)

Elimina hasta el 85% de la captura manual en finanzas de construcción.