Hay un supuesto que se instaló silenciosamente en las empresas desde que los modelos de lenguaje llegaron al trabajo cotidiano: si la IA lo dice con fluidez, probablemente sea correcto. Las respuestas llegan en un tono de autoridad que no varía. No hay titubeos, no hay "creo que", no hay señales de incertidumbre. La IA produce texto como si supiera.

El problema es que los modelos de lenguaje generan texto probable, no texto verdadero. No acceden a una base de datos de hechos verificados. Predicen la siguiente palabra más plausible dado el contexto. Y cuando no saben — porque el tema es reciente, específico, o está fuera de su entrenamiento — no lo dicen. Inventan con la misma fluidez con que informan.

A eso se le llama alucinación. Y en el mundo corporativo, una alucinación de IA que nadie detecta puede tener consecuencias que van desde lo embarazoso hasta lo catastrófico.

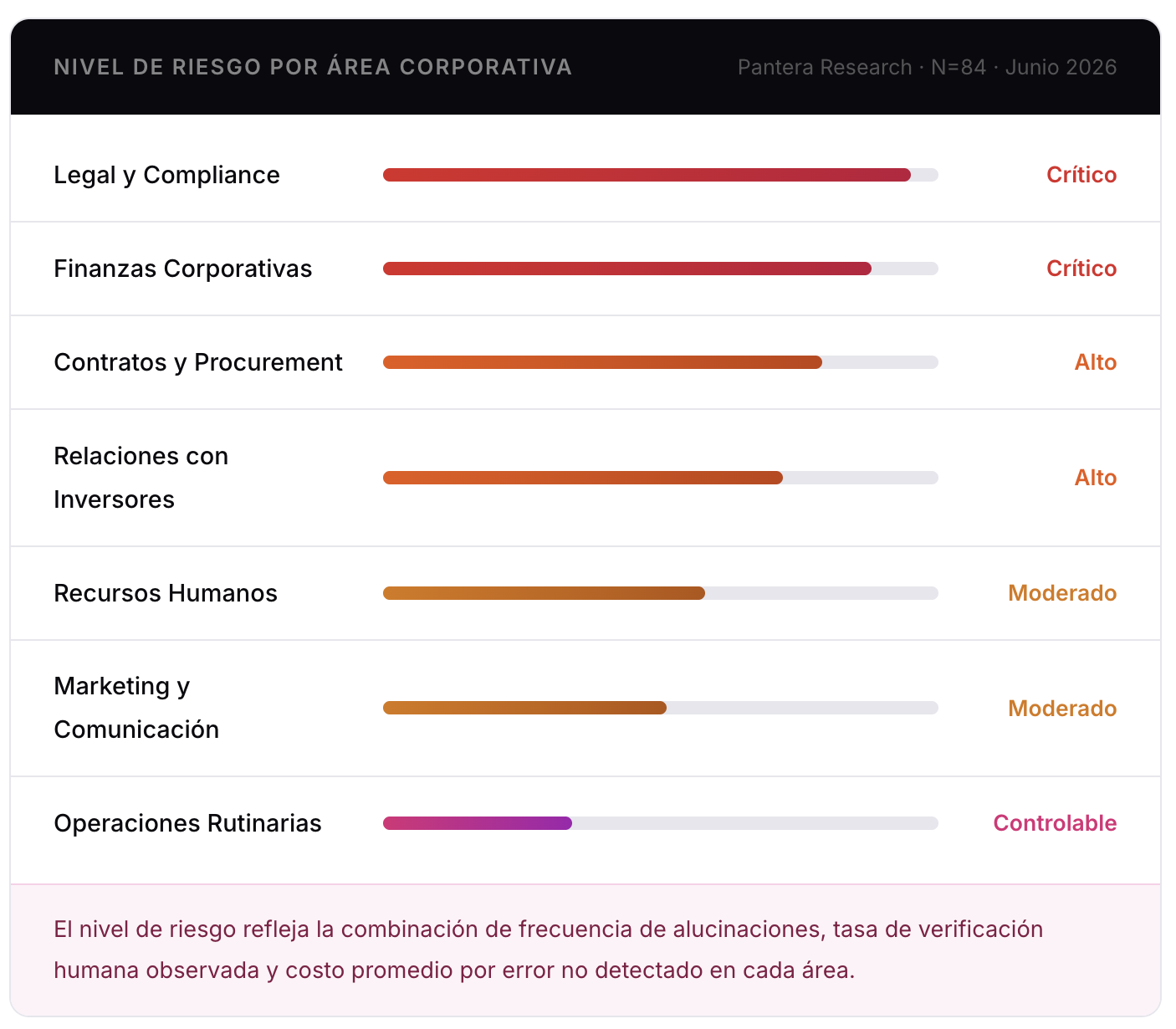

Entre febrero y mayo de 2026, Pantera Research realizó una investigación con 84 empresas de mercado medio y corporativas en Latinoamérica y Estados Unidos, con ingresos entre USD 5M y USD 200M, que ya habían desplegado herramientas de IA generativa en procesos de negocio. El objetivo: cuantificar la frecuencia, el tipo y el costo operativo de los errores atribuibles a alucinaciones de IA.

Para entender el problema es necesario entender cómo funcionan estos modelos. Un LLM no busca la verdad. Predice texto. Fue entrenado en enormes volúmenes de texto humano y aprendió a generar continuaciones plausibles dado un prompt. Esa habilidad lo hace extraordinariamente útil — y estructuralmente propenso a fabricar.

Cuando un modelo enfrenta una pregunta sobre algo que no está en su entrenamiento, o que requiere datos actualizados, o que implica razonar sobre múltiples fuentes en conflicto, no devuelve un error. Genera la respuesta más plausible que puede construir. A veces acierta. Otras, inventa con total convicción.

No todas las alucinaciones de IA son iguales. En contextos de negocio, hemos identificado seis tipos con patrones de daño distintos:

No todos los departamentos tienen la misma exposición. La magnitud del daño depende de tres factores: la frecuencia de uso de IA en el área, el nivel de verificación que existe en los procesos y la consecuencia directa de un error no detectado.

Durante la investigación documentamos incidentes concretos que las empresas clasificaron como atribuibles a alucinaciones de IA. Estos son los cinco patrones más recurrentes, anonimizados.

En el uso personal de IA, el costo de una alucinación es bajo. Si un modelo te da una recomendación de restaurante incorrecta, lo descubres rápido y el daño es cero. El problema en el entorno corporativo es que existen tres mecanismos que amplifican el impacto de cada error.

La mayoría de las empresas con exposición alta a alucinaciones de IA no lo saben porque no han tenido un incidente visible. Pero hay señales estructurales que indican vulnerabilidad:

El problema de las alucinaciones no se resuelve cambiando de modelo ni ampliando el prompt. Se resuelve con una capa de validación estructural que opera por encima del modelo de lenguaje — y que verifica sus outputs antes de que lleguen a manos humanas.

En la arquitectura neuro-simbólica que Pantera implementa, el LLM sigue siendo el motor de generación de lenguaje natural. Pero sus outputs pasan por una capa simbólica que contrasta cada afirmación verificable con un grafo de conocimiento construido sobre las fuentes de verdad de la empresa: documentos internos, bases de datos regulatorias, sistemas ERP, contratos vigentes.

Si el output contiene una afirmación que no puede ser verificada o que contradice una fuente confiable, el sistema lo marca, lo contiene o lo escala — antes de que llegue al usuario.

Antes de evaluar si la arquitectura de validación es relevante para tu operación, estas preguntas ayudan a dimensionar la exposición real:

.png)

.png)

ERP Pasivo se puede integrar a su e-commerce y escalar tu operación eliminando las tareas repetitivas.

.png)

La IA neuro simbolica va ganando terreno en los despachos contables, descubre como:

Descubre como recuperar el tiempo y el control en tu constructora.

Conoce la novedad del ERP Pasivo que esta ayudando a eliminar las tares manuales/repetitivas

Descubre como la IA Neuro Simbolica esta ganando protagonismo en el mundo corporativo y como puedes implementarla en tu empresa.

.png)

Evita los altos costos de las alucinaciones de IA en el sector B2B garantizando la precisión de tus datos

Aprende a gestionar datos financieros con precisión mediante procesos digitales que eliminan el error humano en tu ERP.

.png)

Elimina hasta el 85% de la captura manual en finanzas de construcción.